G1: 画像認識

背景と課題

顕微鏡画像において、細胞や細胞核などの領域を正確に抽出することは、生体現象の定量化における基盤的な処理です。

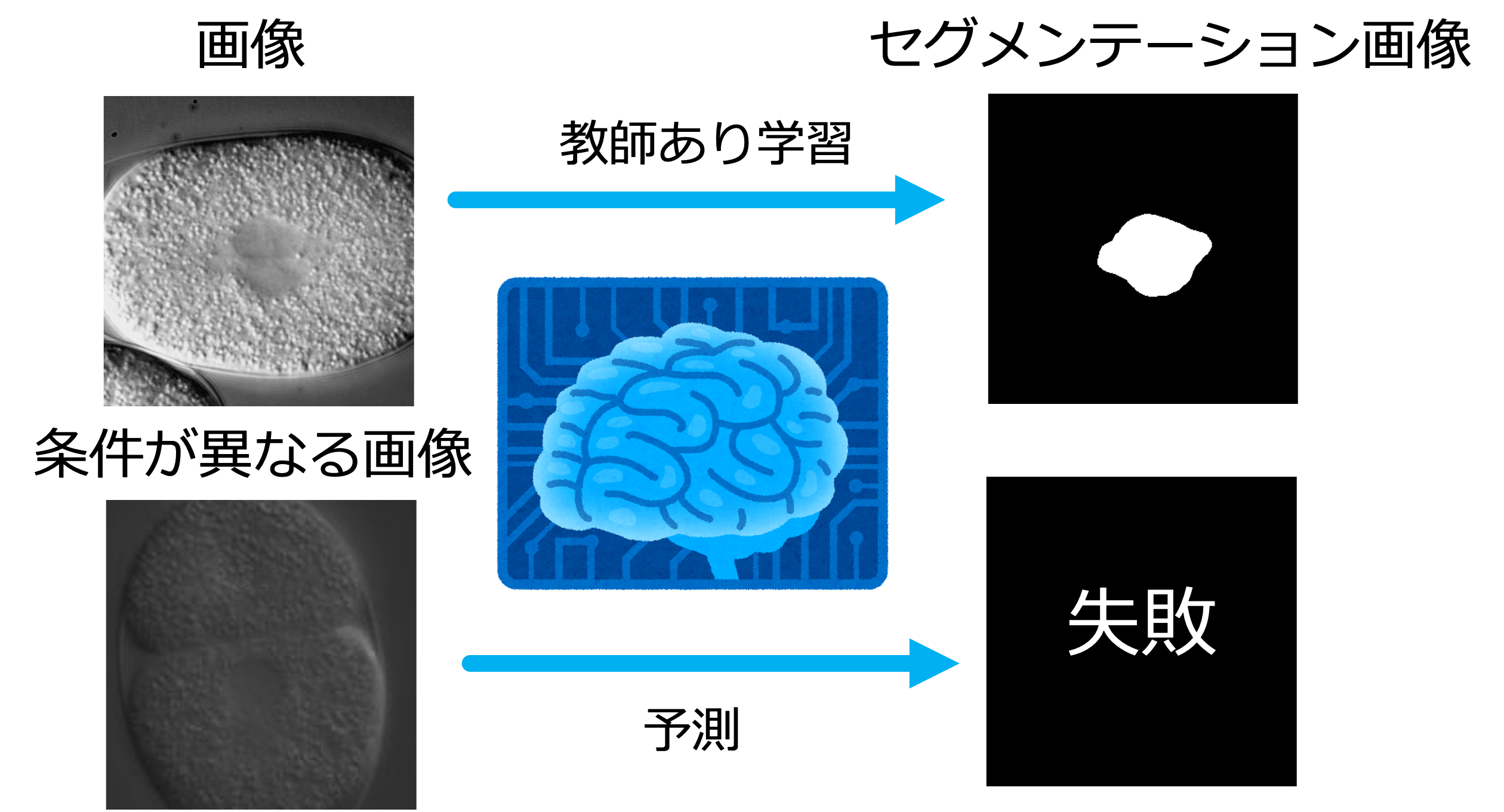

近年は深層学習を用いたセグメンテーション手法が広く用いられていますが、学習データと異なる撮影条件の画像に対しては性能が大きく低下するという課題があります。この問題は、学習データとテストデータの特徴分布の違い(ドメインギャップ)に起因します。

課題の具体例

学習時には正しく領域を抽出できる場合でも、撮影条件が変化すると同じモデルでは対応できないことがあります。

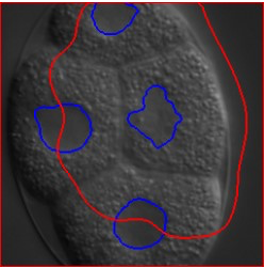

例えば、対象や顕微鏡が同じでもカメラなどが異なるだけで、予測精度は大きく低下します(青:正解データ,赤:推定結果)。

具体例:時系列情報を用いた共有特徴の抽出

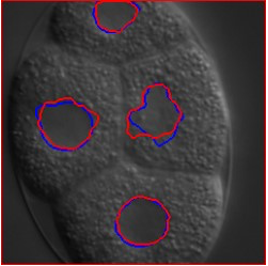

本研究では、画像を独立に扱う従来の枠組みを拡張し、時間的に連続した画像列に対する制約付き表現学習として問題を定式化します。

従来の時系列モデル(例:LSTMやその拡張手法)は、時間的に連続した状態遷移を逐次的にモデル化することを前提としています。しかし、顕微鏡画像においては、撮影条件の変動や観測ノイズの影響により、観測される変化が必ずしも生体状態の変化を反映しているとは限りません。そのため、時系列を直接モデル化するアプローチでは、観測条件の違いに依存した不安定な表現が学習される可能性があります。

そこで本研究では、時間方向の変化そのものを予測するのではなく、複数時点の画像に共通して現れる構造に着目します。時間的に近接した画像は観測条件が変動しても本質的に同一の生体構造を含むと考えられるため、この共通構造を観測条件に依存しない不変量として捉え、特徴表現を学習します。

ここでの制約とは、時間的に近接した画像間で特徴表現が整合するという条件を指し、この制約を満たすようにモデルを学習することで、観測条件の変動に頑健な表現を獲得します。

一方で、観測条件の差異が大きい場合には、特徴分布自体の乖離が顕著となるため、敵対的学習による分布整合化やドメイン汎化の枠組みを併用します。これにより、時間的一貫性に基づく不変表現と統計的分布整合の両面から、より広い条件変動に対応可能なモデルを構築します。

研究の特徴

- 時間的一貫性を不変量とした表現学習

- 特徴表現の共有によるドメイン差の吸収

- 敵対的学習に基づく特徴分布の整合化

対象データと応用

本研究は、線虫胚発生過程の顕微鏡画像、マウス脳画像、大腸菌のタイムラプス画像などに応用しています。

これらのデータに対してセグメンテーションを行うことで、細胞構造の定量化や状態変化の追跡が可能となり、発生過程の理解や細胞動態の解析といった生命科学における重要課題に対して、定量的かつ再現性のある解析基盤を提供します。